빠르게 발전하는 AI 기술을 규제해야 한다는 국내외 요구에 미국 정부가 나섰다. 구글, 오픈AI 등 AI플랫폼 기업들을 백악관으로 회의를 소집하고 의회에서는 규제 입법 움직임을 보이고 있는 것이다.

바이든 정부의 요구는 기업들이 AI기술 안전성에 대한 외부 평가에 응하고 저작권 침해, 정보왜곡 등 AI의 리스크를 막을 책임있는 자율 규제안을 만들라는 것이다.

미국 정부는 중국, EU 등과의 글로벌 AI기술 개발 경쟁에서 앞서는 동시에 ‘AI의 위험성’도 최소화할 수 있도록 하는 ‘AI규제 가드레일’ 수립을 위해 장고를 거듭하고 있다.

[바이든 대통령, AI 잠재력과 위험 동시]

미국 백악관은 2023년 5월 4일(목) 카말라 해리스 미국 부통령(Vice President)와 구글, 마이크로소프트, 오픈AI, 앤쓰로픽(Anthropic) CEO를 루즈벨트 룸으로 불러 ‘AI 개별 현황’과 ‘AI가 야기할 수 있는 문제점’ 등에 대해 논의했다. 2시간 동안 이어진 회의에서 참석자들은 시종일관 AI기술에 대한 우려와 문제점, 대책을 논의한 것으로 알려졌다.

AI가 일자리를 줄이는 등 전사회를 흔들고 있는 사안의 엄중함을 고려, 바이든 대통령도 회의에 잠깐 참석했다. 바이든 대통령은 CEO들에게 “지금 기업들이 하는 사업(AI)은 잠재력과 거대한 위험을 가지고 있다”고 말했다. 백악관은 이 장면을 트위터를 통해 포스팅했다.

Artificial Intelligence is one of the most powerful tools of our time, but to seize its opportunities, we must first mitigate its risks.

— President Biden (@POTUS) May 4, 2023

Today, I dropped by a meeting with AI leaders to touch on the importance of innovating responsibly and protecting people's rights and safety. pic.twitter.com/VEJjBrhCTW

4일 목요일 백악관 회의에 참가한 CEO는 구글 CEO 순다 피차이(Sundar Pichai), 마이크로소프트의 CEO 사티아 나델라( Satya Nadella). 오픈AI의 샘 알트만(Sam Altman), 앤쓰로픽 CEO 다리오 아모데이(Dario Amodei) 등 4명이다.

몇몇 CEO들은 사내 기술 전문가이나 대외 정책 담당자 등을 대동하고 등장한 것으로 전해진다. 백악관 대변인카린 장-피에르은 회의 뒤 성명에서 “대통령은 챗GPT에 대해 전반적인 내용을 브리핑 받았고 AI가 어떻게 작동되고 있다는 것을 안다”고 말했다.

AI회의와 관련, 백악관은 “기업들이 AI의 기술 발전에 따른 위험성을 해결해야 한다는 공감을 가지고 있다는 것에 대해 깊은 인상을 받았다”고 전했다.

회담 후 백악관은 ‘솔직하고 건설적인 논의(frank and constructive discussion)’가 있었다고 전했다. AI 개발 관련 빅테크 기업들이 자신들의 제품에 대한 외부 검증의 필요성을 인지하고 AI의 잘못된 사용을 막아야 한다는 공감대를 가지고 있다는 것이다.

백악관은 또 “이들 CEO와 그들의 기업들이 미국 AI 혁신 생태계(A.I. innovation ecosystem) 에서 차지하는 역할을 고려할 때, 정부는 그들 리더십의 중요성을 강조하고 책임감있는 행동을 요청했다”며 “책임있는 혁신과 적절한 보호, 사람들의 권리와 안정성을 보호할 것을 요구했다”고 덧붙였다.

2022년 11월 생성AI ‘챗GPT’의 등장 이후 백악관이 기업들을 불러모은 건 이번이 처음이다. 특히, 해리스 부통령이 직접 회의를 주재했고 주요 빅테크 기업들을 모두 모아 대책을 나눈 것도 이례적이다.

해리스 부통령은 회의에서 “"민간 부문은 제품의 안전과 보안을 보장해야 할 윤리적, 도덕적, 법적 책임이 있다”며 “ 회사는 미국인들을 보호하기 위해 기존의 법을 준수해야 한다”고 강조했다. 이에 앞선 3월 말 해리스 부통령은 실리콘밸리를 방문해 기업들을 만난 것으로 알려졌다.

백악관의 대응은 ‘AI의 영향력’이 어디까지 미칠지 가늠조차 안될 정도로 파괴력이 엄청나기 때문이다. 텍스트, 오디오, 이미지 등의 기존 콘텐츠를 활용해 새로운 콘텐츠를 만들어내는 인공지능(AI)인 생성AI는 대량 언어 모델(LLM)을 기반으로 설계돼 인간과 유사하거나 더 뛰어난 결과물을 만들어 낸다.

때문에 교육, 법률, 헬스, 국방, 콘텐츠 제작 등 거의 모든 영역에 적용되고 있다. 엄청난 성장에 구글, 마이크로소프트, 애플 등 빅테크들과 미디어, 콘텐츠 기업들도 생성AI 개발에 앞다퉈 뛰어들고 있다.

[전문가들은 AI위험성 잇단 강조]

2022년 11월 오픈AI가 챗GPT를 출시한 이후, 세계에서 많은 테크 기업들은 자신들의 제품에 AI챗봇을 포함시키는데 집중하고 있다. 또 AI 관련 제품 개발도 가속화하고 있고 벤처캐피탈리스트들은 AI스타트업에 수십억 달러를 쏟아넣고 있다. 마이크로소프트는 오픈AI에만 10억 달러를 투자했다.

하지만, AI 개발과 활용에 대한 통합 가이드라인이나 미국 내 법률은 미비한 상태다.

이에 AI범죄 오남용 정보, 저작권침해, 가짜 뉴스 등 AI의 잘못된 사용이 불러올 사안에 대한 대비가 시급하다는 지적도 커지고 있다. AI기술 개발 기업들에게 많은 자체 윤리강령 이나 규칙을 만들어야 한다는 목소리도 높다.

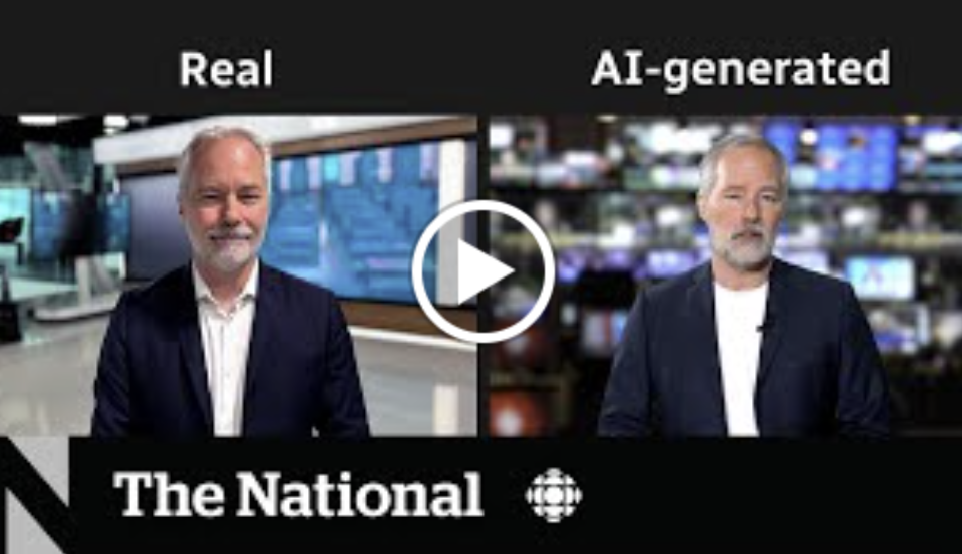

기술 발전과 법적 가이드라인 미비는 공포도 불러오고 있다. 전문가들은 점점 강력해지는 AI를 걱정하고 있다. 최근에는 선거광고에도 AI가 본격격현재 AI 시스템이 사람들을 직장에서 쫓아내고, 허위 정보를 퍼뜨리고, 어쩌면 스스로 법을 어길 수도 있다는 비판이다. 하지만, AI의 체계와 법적 지위는 너무 불투명하다.

Met with @SenSchumer and many members of Congress about artificial intelligence regulation today.

— Elon Musk (@elonmusk) April 27, 2023

That which affects safety of the public has, over time, become regulated to ensure that companies do not cut corners.

AI has great power to do good and evil. Better the former.

심지어 AI 창시자들도 ‘AI세상’을 우려하고 나섰다. AI의 대부로 불리는 지오프리 힌튼(geoffrey Hinton)은 구글을 그만둔 후 이 기술이 초래할 수 있는 위험에 대해 공개적으로 목소리를 높였다. 힌튼 박사는 “AI가 하는 나쁜 일들 막을 수 있는 막을 수 있는 시스템이 없다”고 말했다.

카네기 멜론 대학과 캐나다 대학교 교수였던 힌튼 박사는 2012년 제자 2명(Ilya Sutskever, Alex Krishevsky)과 함께 수천 개의 일반 사진을 분석하고 같은 물건을 식별할 수 있도록 스스로 가르칠 수 있는 신경망(neural network)을 만들었다. 구글은 그가 만든 회사를 인수하는데 4,400만 달러를 썼고 그의 제자 중 한명 일리야 쇼츠케버는 오픈AI의 수석 연구자가 됐다.

조 바이든 미국 대통령도 AI의 위험성에 대한 언급을 늘리고 있다.

바이든 대통령은 2023년 4월 공개 석상에서 “AI가 우리에게 이로운지 아니면 해로운지는 판별되지 않았다”며 “AI의 위험성에 대해 면밀히 살펴볼 필요가 있다”라고 말했다. 또 백악관 고위 관료들은 AI기술이 악용될 경우 정부가 개입할 것이라고 언급”하기도 했다.

미국 의회 멤버들도 AI 기술에 대한 개입 강도를 높이고 있다.

미국 상원 원내 대표인 척 슈머(Chuck Schumer) 등 미 의원들은 규제 초안이나 AI규제법 발의를 준비하고 있다. 그는 4월 26일 테슬라 창업주 일론 머스크를 만나 ‘AI규제와 관련 입법’을 상의하기도 했다.

그러나 AI규제 법안이 생명력을 얻기 위해선 상원에서 60표 이상이 필요하다. 양당의 초당적(Bipartisan) 합의 없이는 필리버스터를 넘기 어렵다는 이야기다.

[신중한 미국, 그들의 AI정책에 쏠린 글로벌]

하지만, 아직까지 미국 바이든 행정부는 정부 차원의 AI에 대한 가이드라인을 세우는데는 신중하다.

AI 분야에서 바이든 행정부는 기업들이 보다 책임감 있게 행동하고 자체 기준을 세우라고 말하면서 EU나 중국에 비해서는 규제 도입 속도가 느리다. AI를 주도하는 기업들이 미국인 만큼 경쟁을 의식해서다.

백악관은 일부 실제 AI규칙 초안을 발표했지만, 여전히 대중에 공표는 하지 않고 있다. 다만 연방 정부 내 AI사용에 대해서만 적용하고 있다. 이에 반해 EU의 경우 AI규제법안 수립에 막바지에 와 있다. 중국도 AI 시스템이 국내 검열 규제 기준을 통과할 것을 요구하고 있다.

하지만, 규제 완화가 아닌 규제 공백은 문제라는 지적이다. 톰 휠러 FTC 전 의장은 뉴욕타임스와의 인터뷰에서 “유럽은 수수방관하지 않을 것이며 중국도 마찬가지”라며 “시장에서 퍼스트 무버 우위가 있는 만큼 정책에서도 퍼스트 무버 우위가 있다”고 강조했다. 휠러는 또 “모든 눈들이 미국이 어떤 정책을 취하는지 보고 있다”며 “우리는 경기에서 플레이어로 뛰어야한다”라고 덧붙였다. AI 규제에서도 뒤쳐지면 안되나는 이야기다.

미국 백악관이 기업들의 책임감과 자체 노력을 강조했지만 AI기업들과 법률 대리인들은 미국 정부의 방향성을 예의 주시하고 있다.

AI를 주도하고 있는 기업들이 빅테크인 만큼 소셜 미디어에 이어 AI 시대에도 빅테크의 과점 상태가 이어질 것을 우려하고 있다. 일부는 미국 정부와 의회가 빠르게 성장하는 AI에 대한 규칙을 정하는 조치를 취할 필요가 있다고 말하며 비난하고 있다.

[FTC,AI를 반드시 규제해야 한다]

이 회의에 앞서 미국 행정부는 AI 규제나 가이드라인을 위해 전혀 손을 놓았던 것은 아니다. 2022년 10월 백악관은 ‘AI 권리 장전 초안( blueprint for an A.I. bill of rights)’을 내놨었다.

이 초안에는 자동화 시스템은 반드시 이용자 데이터 보호와 차별적인 결과 산출 방지, 특정 조치가 취해진 이유에 대한 명확한 해답 등을 담아야 한다고 게재됐다. 2023년 1월 미국 상무부(Commerce Department)는 수년 간의 연구 끝에 AI 개발의 위험성을 줄이는 프레임워크를 공개했다. 미국 정책 규제 기관들도 움직이고 있다.

리나 칸(Lina Khan) 미국 연방공정거래위원회(FTC) 의장은 2023년 5월 3일 뉴욕타임스 기고에서 "국가는 AI에 대해 핵심적인 결정점(key decision point)에 있다”고 강조했다. 칸 의장은 최근 AI기술 발전을 구글이나 페이스북 탄생에 비유하며 적절한 규제 없이는 기술은 대형 빅테크 기업들의 힘을 공고히 할 것이며 사기꾼들에게 강력한 도구를 제공할 수 있다”고 강조했다.

AI를 적절한 시점과 방향으로 규제하지 않는다면 구글과 페이스북 이상의 빅테크들의 등장할 수 있다는 이야기다. 리나 칸의 기고문 제목은 ‘ 우리는 반드시 AI를 규제해야 한다(We Must Regulate A.I. Here’s How)’였다. 칸 위원장은 “AI의 사용 더욱 더 커져감에 따라, 정부 기관들은 더 큰 책임감을 가지고 어렵게 배운 역사를 반복하면 안된다”고 강조했다.

결국 미국 내 여론과 글로벌 AI개발 트렌드를 봤을 때, 미국 정부는 기업들의 AI정보 공개 투명성을 높이는 방향으로 규제 틀을 잡을 가능성이 높다.

또 기업들의 AI기술 개발이나 연구를 최대한 방해하지 않고 문제가 있을 경우 사후 과징금 등을 통해 ‘AI의 위험’을 최소하려는 전략이 펼칠 것으로 예상된다.

[오는 여름, 연방 정부 AI가이드라인 내놔]

정부는 2023년 여름 연방 기관들을 위한 AI 가이드라인 초안을 내놓겠다고 약속했다. 이와 관련 연방 예산국(the Office of Management and Budget)은 연방 정부의 AI시스템 사용에서 정책 지침 초안을 대중에 공개한다.

아울러 백악관은 ‘미국 국민의 권리와 안전(he American people’s rights and safety)’을 보호하며 여러 AI 회사들은 8월에 사이버 보안 회의에서 그들의 제품을 정밀 조사하는데 협조했다고 공개했다.

2023년 8월 앤쓰로픽, 구글, 허깅 페이스, 마이크로소프트, 엔비디아, 오픈AI, 스테이빌리티(Stability) 등이 참가하는 메이저 해커 이벤트 ‘데프콘31(Defcon31)’ 의 ‘independent exercise’ 에서는 기업들의 생성AI 시스템이 바이든 행정부의 AI권리 장전에 얼마나 충실한 지에 대한 공개 평가 결과가 공개된다.

회의 몇 시간 전, 백악관은 연방 과학 재단(National Science Foundation)이 AI 지정 신규 연구 센터에 1억 4, 000만 달러를 투자할 계획이라고 밝혔다.

![[Report]Ofcom 'Future of TV Distribution'](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.directmedialab/2024/05/guwd3g_202405122027.png)

![[PT]NAB2024 the Era of conversational AI](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.directmedialab/2024/05/qc7q4b_202405081558.png)

![[PPT-Report]대화형 AI의 시작 "NAB2024"](https://storage.googleapis.com/cdn.media.bluedot.so/bluedot.directmedialab/2024/05/yhln3l_202405081556.png)